Proyecto Astra, la herramienta futurista de Google capaz de ver, oír, hablar, recordar y asimilar

SOCIEDAD

La compañía se suma a las tecnológicas que apuestan por asistentes que interactúan con el usuario

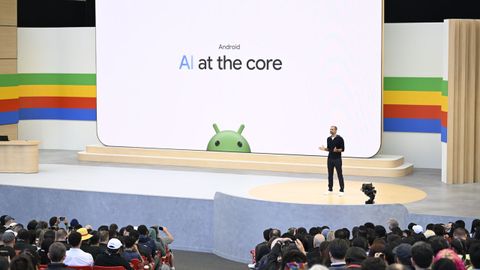

15 may 2024 . Actualizado a las 10:24 h.Google presentó este martes —el mismo día que su rival OpenAI desempaquetaba la nueva versión del ChatGPT, la 4o— su Proyecto Astra, un asistente de inteligencia artificial (IA) con «habilidades humanas» que le permiten ver, oír, hablar, recordar y asimilar. La compañía mostró varios ejemplos de esta herramienta futurista que prevé lanzar a finales de año; en ellos, distintos trabajadores preguntaban al asistente qué apodo le pondría a una mascota, dónde estaban sus gafas o de qué manera podían resolver ejercicios de codificación y matemáticos.

Como el nuevo ChatGPT, el de Google puede ser interrumpido durante sus respuestas para pasar al siguiente punto de la conversación, y está programado para adquirir distintas personalidades. «Estos agentes se crearon sobre nuestro modelo Gemini y otros modelos de tareas específicas, y fueron diseñados para procesar información más rápidamente, codificando continuamente cuadros de vídeo, combinando la entrada de vídeo y voz en una línea de tiempo de eventos y almacenando en caché estos datos para recuperarlos de manera eficiente», explicó la empresa a través de un comunicado.

Con gafas inteligentes

Pero Google se sacó el martes un as de la manga, sorprendiendo con la posibilidad de usar esta tecnología con unas gafas inteligentes, además de con un teléfono. También Meta —Facebook, Instagram y WhatsApp— avanzó en su último evento de desarrolladores que está desarrollando sus lentes inteligentes para que puedan acceder a su IA y contestar a los usuarios preguntas sobre lo que ven.